2022年8月31日、Lightship ARDKのv2.2がリリースされました。

本リリースにより実装された機能は大きく4点。

Playbackサポート、セグメンテーションに人物を追加、手のひらのトラッキング、Wayspot Anchor APIのアップデートとなります。

どういったものか順番に見ていきましょう!

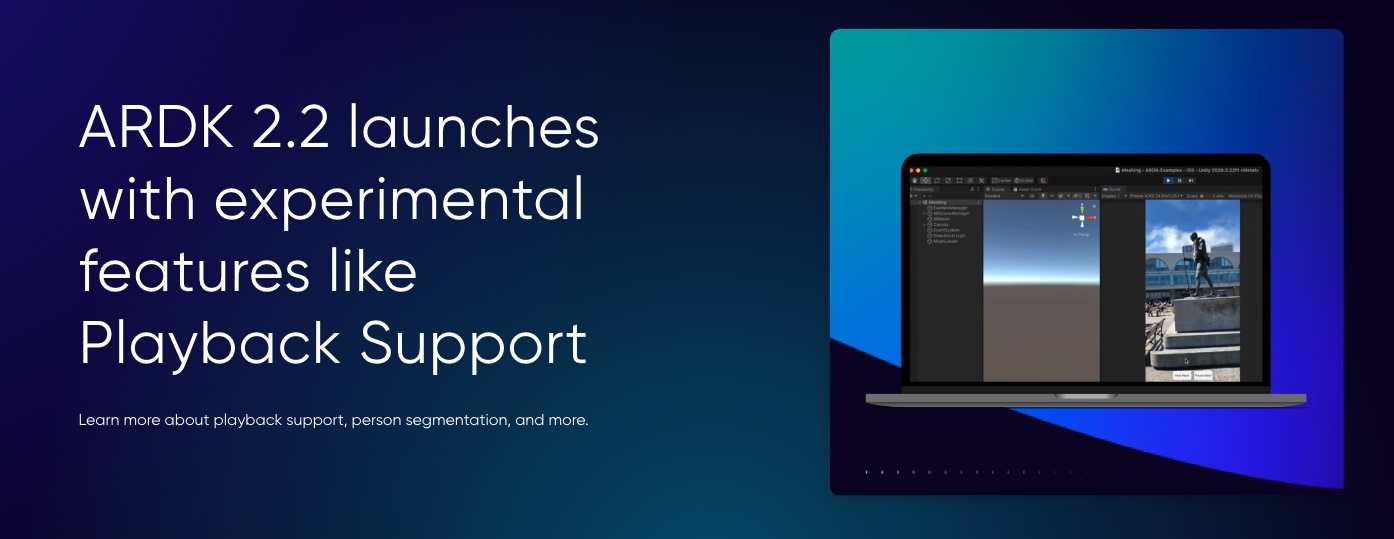

Playbackサポート

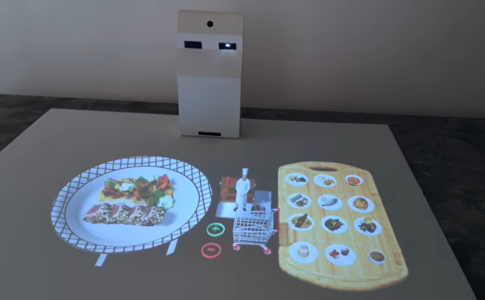

Playbackサポートを使うと、実環境で行なった体験を全て記録し、開発環境上でメッシュ、深度、セグメンテーション、アンカーといった情報を再現できるようになります。リリース時点ではIntel Macで実験的に利用が可能です。

ARのテストの際に何度も現地に足を運ぶ必要がなくなるため、開発時間の短縮につながります。

リリースページでは、実環境で作成したメッシュをunity上で再現している様子が見られます。

ドキュメントはこちら。

セグメンテーションに人物を追加

以前より、セグメンテーションとして外部環境を理解する機能は実装されていました。全部で8種類あり、空、地面(人工、自然とわず)、自然物の地面(土や泥など)、人工物の地面(道路など)、水源(川や池、プールなど)、建物、葉(花や木の葉)、草地(芝生など)が該当します。ここに人物が加わりました。

この機能によりカメラアプリにあるような、フィルターなどの表現が可能となりました。

すでにサンプルにも追加されており、ビルドするだけで下記のように体験が可能です。

手のひらのトラッキング

手のひらのトラッキングはまだ実験的な機能となります。開いた手を検出することで物を押し込む、手のひらに物を置くなどのインタラクションが可能となります。

この機能はLightshipで「HumanARを提供するための最初の一歩」としており、将来的にさまざまな機能が追加されることが予想されます。

サンプルは用意されていませんが、ドキュメントはこちらにあります。

Wayspot Anchor APIのアップデート

Lightship VPSなどで使用されるWayspot Anchorのトラブルシューティングに役立つAPIが8つ追加されました。

また、新しくWayspot Anchorに追従するGameObjectの位置変更の関数を簡単に実装できるようになりました。

まとめ

今回のアップデートで人体に関する認識が大幅に強化されました。

現状、Android・iOS問わず使えるライブラリで人体認識ができるものは少ないため、Lightshipが対応したことで表現の幅がぐっと広がったことになります。

また対象が限定されているものの、Playbackサポートにより開発がよりしやすくなりました。

ARのライブラリとしてより強化されていくLightship ARDK、今後も注目です。